안녕하세요! 인공지능이 우리 삶에 깊숙이 스며들면서, 우리는 수많은 AI 기술과 마주하고 있어요. 그런데 과연 이 AI 모델들이 얼마나 똑똑하게, 그리고 믿음직스럽게 작동하고 있는지는 어떻게 알 수 있을까요?

바로 인공지능 모델 평가지표를 통해서입니다. 이 지표들은 AI 모델의 성공 여부를 가늠하는 중요한 척도가 되죠.

인공지능 모델의 성능을 정확하게 평가하는 것은 개발 단계뿐만 아니라 실제 서비스 운영에 있어서도 매우 중요합니다.

이 글에서는 인공지능 모델 평가지표가 무엇인지, 왜 중요한지, 그리고 주요 평가지표들은 어떤 것들이 있는지 쉽고 명확하게 설명해 드립니다. 복잡하게만 느껴졌던 평가지표들을 함께 살펴보며 AI 모델을 더 깊이 이해하는 시간을 가져보세요!

인공지능 모델 평가지표, 왜 중요할까요?

인공지능 모델을 평가하는 것은 마치 시험을 본 학생의 점수를 매기는 것과 같아요. 점수가 있어야 학생이 어느 과목에 강하고 약한지 알 수 있듯이, 평가지표가 있어야 AI 모델의 장단점을 파악하고 개선 방향을 설정할 수 있습니다.

- 객관적인 성능 비교: 여러 모델 중 어떤 모델이 특정 문제 해결에 더 적합한지 객관적으로 비교할 수 있게 해줍니다.

- 모델 개선 방향 제시: 지표를 통해 모델이 어떤 유형의 데이터에서 취약한지, 어떤 오류를 자주 범하는지 파악하여 개선점을 찾을 수 있습니다.

- 신뢰성 확보: 모델의 성능을 수치로 증명함으로써 사용자나 이해관계자에게 신뢰를 줄 수 있습니다.

- 의사결정 지원: 비즈니스 목표와 연관된 지표를 설정하여 모델 도입 및 활용에 대한 합리적인 의사결정을 돕습니다.

💡 팁: 인공지능 모델은 목적과 데이터 특성에 따라 다양한 평가지표를 사용해야 해요. 단순히 하나의 지표만 보고 모델의 성능을 판단하는 것은 위험할 수 있습니다.

주요 인공지능 모델 평가지표 살펴보기

이제 실제 모델에서 자주 사용되는 평가지표들을 유형별로 자세히 알아볼까요? 모델의 종류에 따라 중요하게 봐야 할 지표들이 다르답니다.

1. 분류(Classification) 모델 평가지표

이미지 분류, 스팸 메일 분류 등 데이터를 특정 카테고리로 나누는 모델에 사용됩니다. 가장 보편적이고 중요한 지표들이 많아요.

| 지표 | 설명 | 활용 예시 |

|---|---|---|

| 정확도 (Accuracy) | 전체 예측 중 올바르게 예측한 비율. | 가장 직관적이지만, 데이터 불균형 시 오해의 소지 있음. |

| 정밀도 (Precision) | 양성으로 예측한 것 중 실제 양성인 비율. | 스팸 메일 분류 (스팸이 아님에도 스팸으로 분류하면 안됨). |

| 재현율 (Recall) | 실제 양성인 것 중 양성으로 올바르게 예측한 비율. | 질병 진단 (실제 환자를 놓치면 안됨). |

| F1-점수 (F1-Score) | 정밀도와 재현율의 조화 평균. | 정밀도와 재현율 모두 중요할 때 사용. |

| AUC-ROC | 모델의 분류 임계값 변화에 따른 성능을 나타내는 면적. | 민감도와 특이도 간의 트레이드오프를 보여줌. |

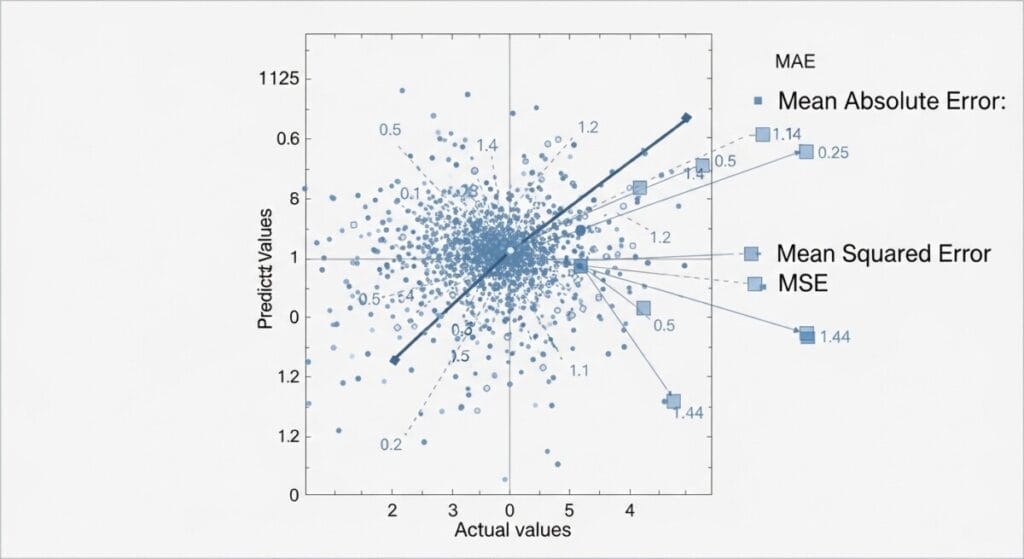

2. 회귀(Regression) 모델 평가지표

주택 가격 예측, 주식 시장 예측 등 연속적인 값을 예측하는 모델에 사용됩니다. 주로 실제 값과 예측 값의 오차를 측정해요.

- MAE (Mean Absolute Error): 실제 값과 예측 값의 절대 오차 평균. 오차의 방향성보다 크기가 중요할 때 유용해요.

- MSE (Mean Squared Error): 실제 값과 예측 값의 제곱 오차 평균. 큰 오차에 더 큰 페널티를 부여하고 미분이 용이하여 최적화에 자주 사용됩니다.

- RMSE (Root Mean Squared Error): MSE에 루트를 씌운 값. 오차의 단위를 원래 데이터와 맞춰 해석하기 좋습니다.

- R² (결정계수): 모델이 얼마나 데이터를 잘 설명하는지를 나타내는 지표. 0에서 1 사이의 값을 가지며, 1에 가까울수록 모델의 설명력이 높다고 볼 수 있습니다.

3. 기타 모델 평가지표

위 두 가지 유형 외에도 다양한 모델에 특화된 평가지표들이 있습니다.

- 군집(Clustering) 모델: 실루엣 계수(Silhouette Score), DBI(Davies-Bouldin Index) 등 군집의 밀도와 분리도를 평가합니다.

- 자연어 처리(NLP) 모델: BLEU (번역), ROUGE (요약), Perplexity (언어 모델) 등 텍스트 생성 및 이해 능력을 평가합니다.

- 추천 시스템: Precision@k, Recall@k, NDCG (정규화된 할인 누적 이득) 등 사용자에게 얼마나 적절한 아이템을 추천하는지 평가합니다.

⚠️ 주의사항: 평가지표는 언제나 완벽하지 않습니다. 특정 지표만 맹신하기보다는 모델의 목적, 데이터의 특성, 그리고 발생할 수 있는 잠재적 위험을 종합적으로 고려하여 지표를 선택하고 해석해야 합니다. 예를 들어, 극도로 불균형한 데이터셋에서는 정확도만으로는 모델 성능을 제대로 평가하기 어렵습니다.

💡 핵심 요약

1. 평가지표는 AI 모델의 성능을 객관적으로 측정하고 비교하는 기준입니다.

2. 분류 모델에는 정확도, 정밀도, 재현율, F1-점수 등이 주로 사용됩니다.

3. 회귀 모델은 MAE, MSE, RMSE, R² 등으로 예측 오차를 분석합니다.

4. 모델의 목적과 데이터 특성을 고려하여 적절한 지표를 선택하는 것이 가장 중요합니다.

모델 평가 지표는 AI 모델 개발과 운영의 핵심 단계이며, 정확한 이해는 더 나은 AI 솔루션을 만드는 데 필수적입니다.

자주 묻는 질문 (FAQ)

Q1: 정확도가 높으면 항상 좋은 모델인가요?

A1: 아니요, 항상 그렇지는 않습니다. 예를 들어, 99%가 정상 데이터이고 1%만 이상 데이터인 경우, 무조건 ‘정상’이라고 예측하는 모델도 99%의 정확도를 가질 수 있습니다. 이런 경우, 정확도보다는 정밀도, 재현율, F1-점수 등 다른 지표를 함께 고려해야 합니다.

Q2: 평가지표 선택 시 가장 중요하게 고려해야 할 점은 무엇인가요?

A2: 모델이 해결하려는 ‘문제의 목표’와 ‘데이터의 특성’을 가장 중요하게 고려해야 합니다. 예를 들어, 암 진단 모델이라면 실제 환자를 놓치지 않는 것(재현율)이 매우 중요하고, 스팸 메일 분류라면 정상 메일을 스팸으로 오분류하지 않는 것(정밀도)이 더 중요할 수 있습니다.

Q3: 모델 학습 중에도 평가지표를 확인해야 하나요?

A3: 네, 학습 중에도 훈련(training) 데이터셋과 검증(validation) 데이터셋에 대한 평가지표를 주기적으로 확인하는 것이 좋습니다. 이를 통해 모델이 과적합(overfitting)되거나 미흡하게 학습(underfitting)되는 것을 방지하고, 적절한 시점에 학습을 중단하거나 하이퍼파라미터를 조정할 수 있습니다.

마무리 하며…

오늘은 인공지능 모델 평가지표에 대해 자세히 알아보는 시간을 가졌습니다. 단순히 모델을 개발하는 것을 넘어, 그 성능을 정확히 이해하고 평가하는 것은 AI 프로젝트의 성공에 필수적인 과정이라고 생각해요.

다양한 평가지표들이 어떤 의미를 가지며 언제 사용되어야 하는지 이해하는 것은 복잡한 AI 모델의 ‘속마음’을 들여다보는 것과 같다고 할 수 있습니다.

인공지능 분야는 끊임없이 발전하고 있고, 새로운 모델과 기술들이 계속해서 등장하고 있습니다. 이 변화의 흐름 속에서 기본을 튼튼하게 공부하는 것이 여러분을 더욱 유능한 AI 전문가로 성장시키는 중요한 발판이 될 것입니다.

포기하지 않고 꾸준히 공부해서 언젠가 이 분야 최고의 전문가가 되시기를 진심으로 응원합니다! 파이팅!